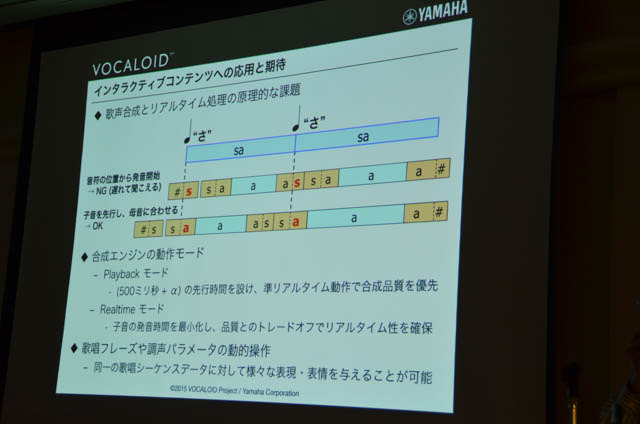

まず石川氏は歌声合成とリアルタイム処理の原理的な課題を挙げました。音符とジャストタイムで発音を開始すると遅れて聞こえてしまうため、子音を先行し、母音に合わせなければならないと言います。そのためリアルタイム処理は極めて困難だったのですが、VOCALOIDでは、先行時間を設け準リアルタイムで合成させる「Paybackモード」と、子音の発音時間を最小化しリアルタイム性を確保する「Realtime」モードを使い分けることで、この問題に対処していると言います。

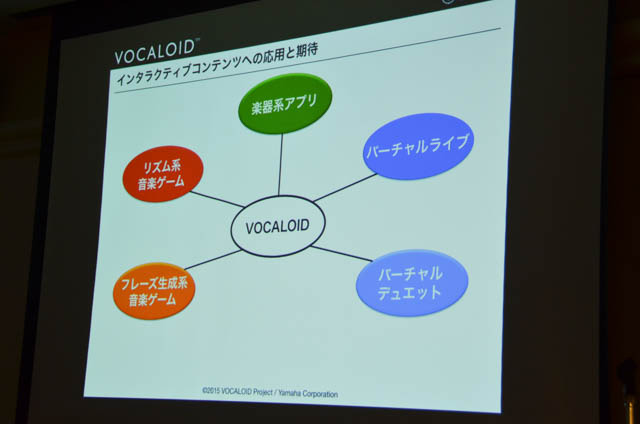

これによりVOCALOIDは、音楽アプリ、リズム系音楽ゲーム、バーチャルライブといった様々なインタラクティブ展開ができると言います。

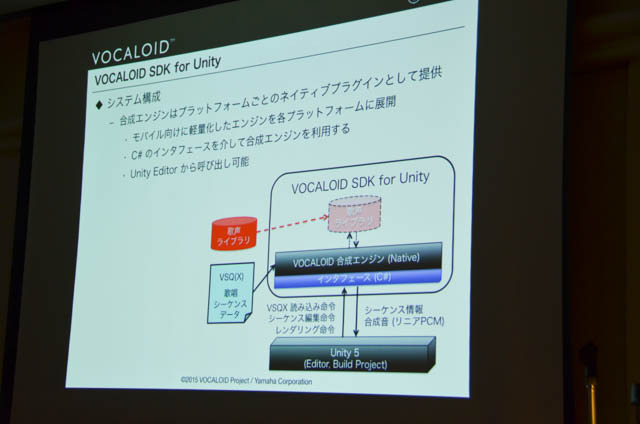

ここからは、本題である「VOCALOID for Unity」についてです。Unityとのコラボレーションについては、同社が成し遂げたゲーム開発の民主化、3DCGキャラクター、VRコンテンツへの期待があったからだと言います。

次に歌声の合成処理の特徴が紹介されました。アプリケーション起動後に、VOCALOIDシーケンスデータを読みこむことで、ほぼリアルタイムで合成音を得ることができると言います。またリアルタイムでフレーズや表情、テンポなどを変更することも可能なようです。

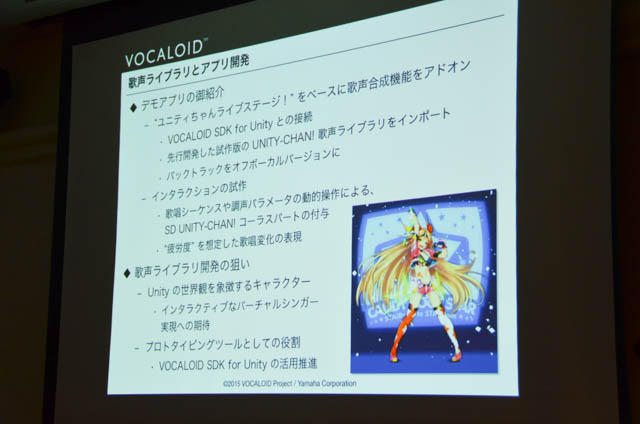

ここで、会場のスクリーンにてデモアプリ「ユニティちゃんライブ・ステージ!」が披露されました。“ユニティちゃん”とは、ユニティ・テクノロジーズ・ジャパンのオリジナルキャラクター“のこと。歌唱の途中、疲れてきたユニティちゃんは音程を外すようになりますが、タップして応援すると見事に復帰。こうした遊びも取り入れられているようです。

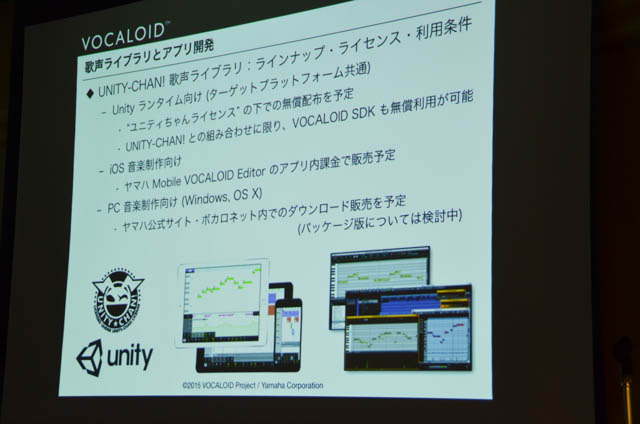

また「VOCALOID for Unity」では、“ユニティちゃん”の歌声ライブラリを“ユニティちゃんライセンス”の下で無償配布予定とのこと。狙いとしては、Unityの世界観を象徴する“ユニティちゃん”へ、インタラクティブなバーチャルシンガー実現への期待を込めているそうです。

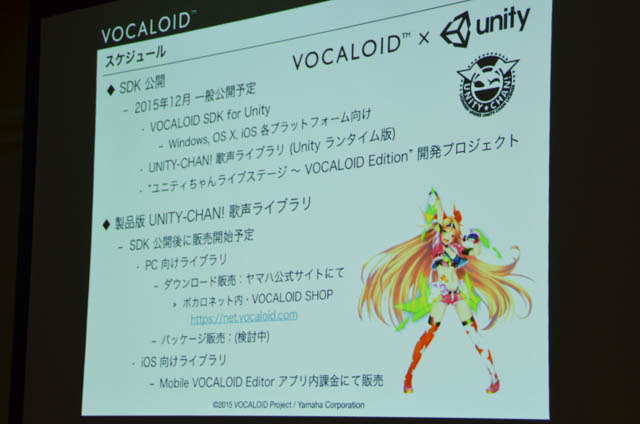

「VOCALOID for Unity」のSDK公開は、2015年12月を予定で、Windows、OS X、IOSなど各プラットフォームで展開とのこと。製品版「UNITY-CHAN! 歌声ライブラリ」については、SDK公開後に販売開始予定となります。