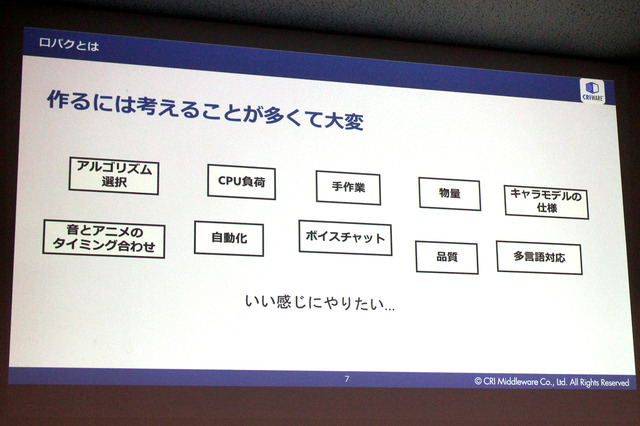

説明会で登壇した同社研究開発部の柴田修作氏は、従来の"口パク"演出を作る際の問題点や課題を挙げつつ、「CRI ADX LipSync」がいかにそれを解決・解消するか……という構成で講演を行いました。ひとつずつ紹介していきましょう。

◆従来の手法の問題・課題1:2種類の口パクデータ生成法

キャラクターのセリフやボイスに合わせて、かつては手作業でキャラの口の形を仕込んでいた口パク。デザイナーがつきっきりで手がけることでクオリティは高いものにできますが、セリフやボイス量は大ボリューム化の一途をたどり、やがて現実的なものではなくなっていきました。

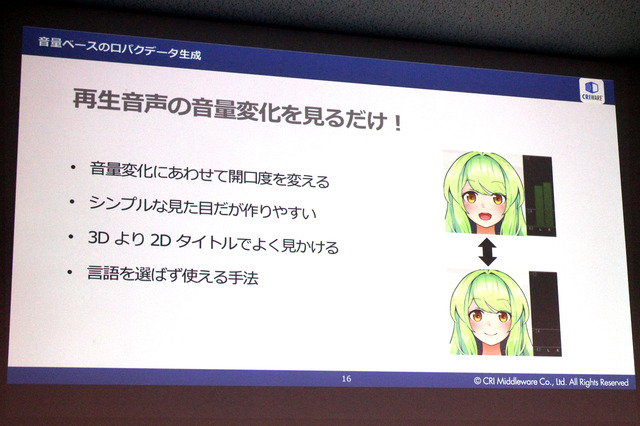

畢竟、自動化の波がやってくることになり、脚光をあびたのが音声解析です。一番シンプルなのは、再生音声の音量の大小だけを参照し、その変化に合わせて開口度を変えるという「音声ベース」の手法です。データ作りやすく、かつ、言語を選びませんが、品質という点ではあくまで"そこそこ"といえます。

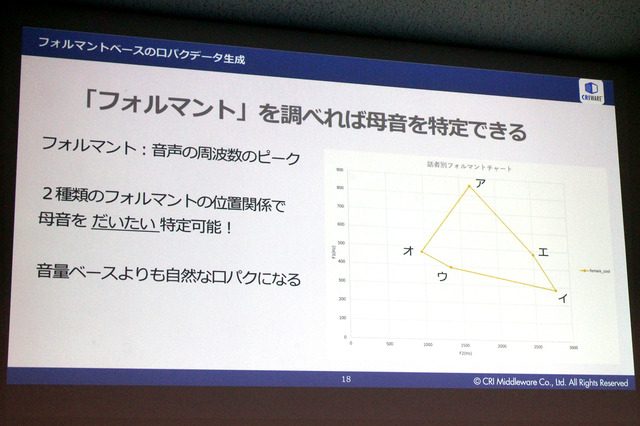

品質を高めるための手法としては、フォルマント(音声の周波数のピーク)を解析して母音を特定する「フォルマントベース」が挙げられます。「音声ベース」ではなしえなかった母音の特定ができますが、抽出されるフォルマントチャートの傾向が話者によって異なる、子音を含むすべての音素を判別できるわけではないなどの課題が残ります。

こうした手法を元に、3Dモデル側は音素別に用意した表情を適宜切り替えるのか、シンプルに口は縦方向にのみ動かすのか、母音は気にせず口を音に合わせ縦と横の2軸に動かすのかなどさまざまな構造が考えられ、口パクデータと3Dモデル、どちらかをどちらかに合わせる必要がありました。

◆「CRI ADX LipSync」のソリューション

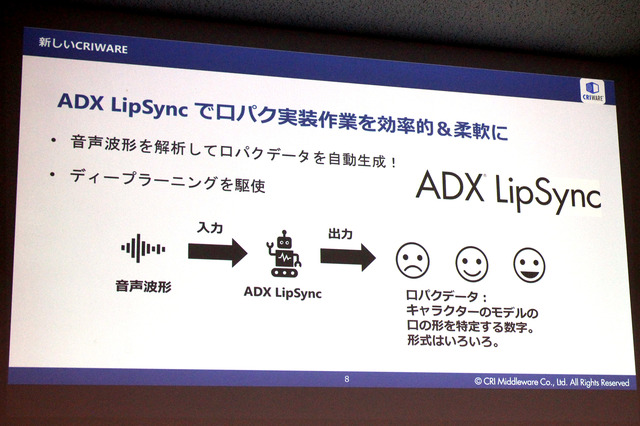

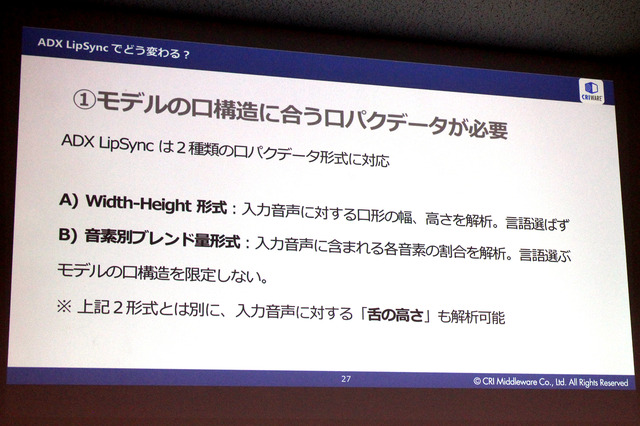

「CRI ADX LipSync」ではディープラーニングが使用されており、音声の波形から判断して以下の2種類の口パクデータを生成。広く対応できる柔軟性を確保しました。

■Width-Height形式:入力音声に対する口形の幅、高さを解析して生成

■音素別ブレンド量形式:「aが80%、eが20%」のように音声に含まれる音素の割合を解析

また、上記の2形式とは別に、入力音声に対する「舌の高さ」も解析可能となっています。

◆従来の手法の問題・課題2:唇音への対応

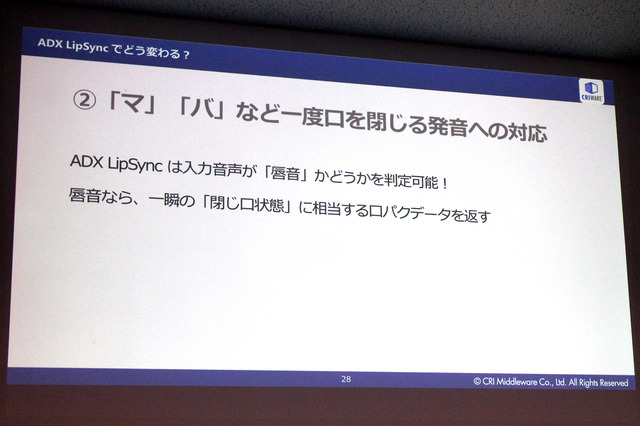

日本語でいうなら「ま行」、「バ行」、「パ行」のように、「一度口を閉じなければ発音できない」音を唇音といいます。「イイイイ」というセリフと「右耳」というセリフでは、母音はすべて同じながら、口の開き方が異なります。しかし、前述のフォルマント解析では唇音を判別できないので、別途、何らかの手段で対応する必要がありました。

◆「CRI ADX LipSync」のソリューション

「CRI ADX LipSync」は唇音にも対応。入力音声の中に唇音がある場合、「(一瞬だけ)口を閉じた状態」というような状態を含む口パクデータを生成できます。

◆従来の手法の問題・課題3:言語によって異なる母音への対応

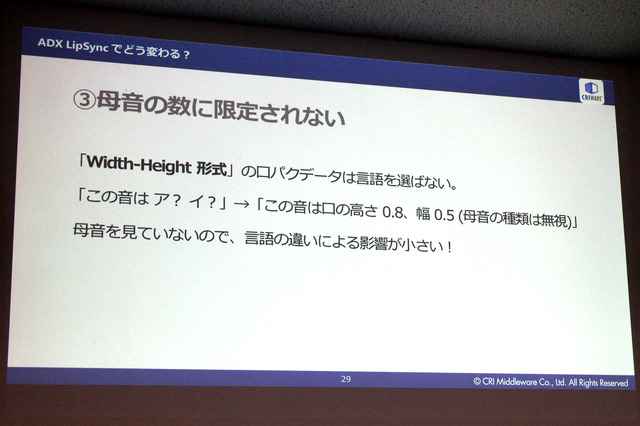

前述した「フォルマントベース」で生成されたデータで口パク演出を作る場合は、その言語の母音の数に対応した表情パターンを用意・追加する必要がある。

◆「CRI ADX LipSync」のソリューション

「Width-Height形式」で生成された口パクデータは「この音は口の高さが0.8、幅が0.5」というように音を参照して幅と高さを割り出すので、母音による影響を受けづらく、どのような言語であっても影響が小さいという強みがあります。

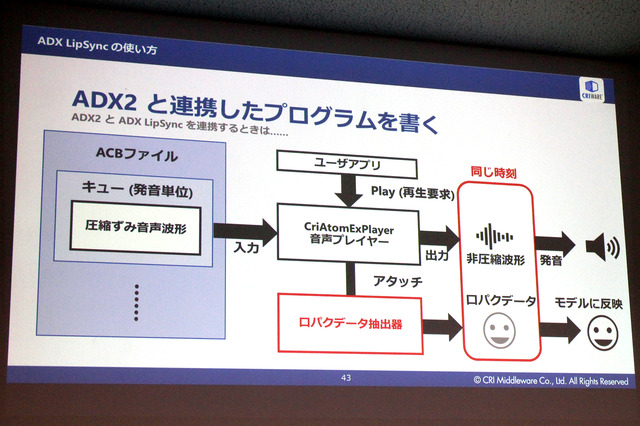

さまざまな面における強みが紹介されたところで、続いては「CRI ADX LipSync」の使い方が紹介されました。一つ目は、音声再生と同時に口パクデータを生成するリアルタイム方式が挙げられました。ベースとなる「CRI ADX2」のプログラムに「CRI ADX LipSync」で定義されているオブジェクト(画像でいう「口パクデータ抽出器」)がアタッチされ、入力された音声が出力されるのと同時に口パクデータが生成され、モデルに即時反映されます。手軽ですが、解析制度の兼ね合いで品質には限度があるほか、データ量に応じた解析負荷がかかります。

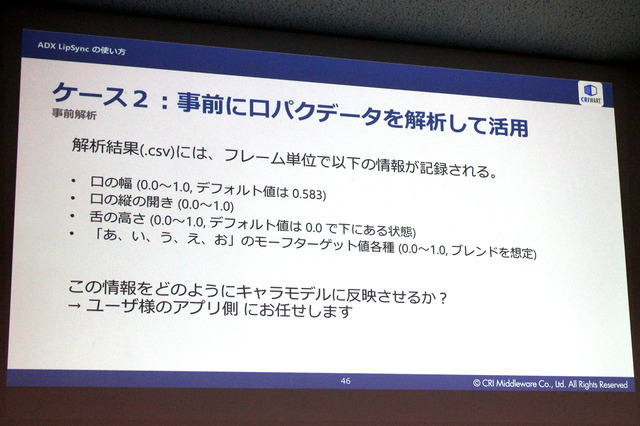

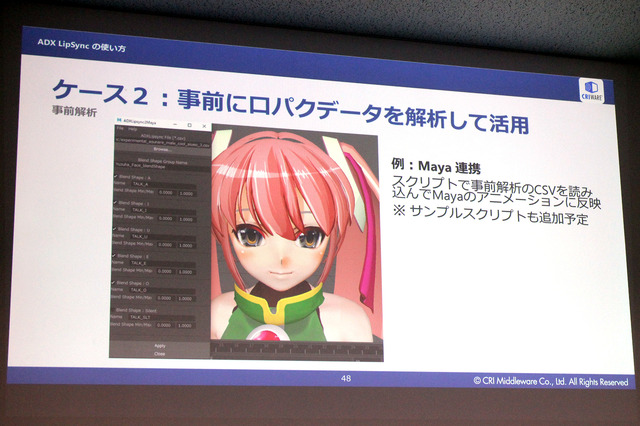

二つ目は、事前に音声データの波形から口パクデータを生成し、それを土台に編集する手法です。csvファイルで生成される口パクデータには「口の幅」、「口の縦の開き」、「舌の高さ」、「a、i、u、e、oのモーフターゲット値」がすべてフレーム単位で記録されるので、それを任意の使い方で3Dモデルに反映させることができます。また、csvファイルには音量も記録する方向で検討中とのことです。

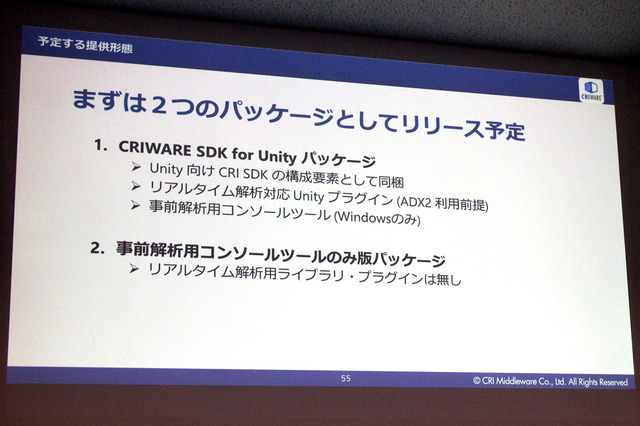

「3Dモデルや言語を選ばない柔軟な口パクデータ生成」、「唇音への対応」、「「CRI ADX2」との連携によるシンプルなAPIと事前解析用CUIツール」を備えたリップシンクミドルウェア「CRI ADX LipSync」は今秋リリース予定。当面はUnity環境で「CRI ADX2」との併用を見込んだ「CRIWARE SDK for Unity」と「事前解析用コンソールツールのみ」という2種類のパッケージが展開予定です。柴田氏は「その他の使用形態に関しても柔軟に対応いたしますので、気になったならお気軽にご相談ください」と語り、セミナーはしめくくられました。

(C)CRI Middleware Co., Ltd. All Rights Reserved